対談記事(16):アルゴリズムによる与信判断に対するベルリンの制裁金事例を通して、GDPR と EU AIAct を理解する

松岡:本日は、ベルリンの監督当局が、銀行に対して、GDPR に基づき制裁金を課した事例を用いて、GDPR と EU AI Act を勉強していきたいと思います。日本には GDPR22 条のプロファイリングについての規制や EU AI Act のように包括的に AI を規制する法令があり

ません。日本人によるプロファイリング規制や AI Act を日本人が理解することを難しくしていると思います。具体的な事例を用いることにより、欧州の規律をより深く理解できるのではないかと考えています。

1. 執行事例の事案の説明

松岡:まず、執行事例(以下「ベルリン事案」といいます。)の事案の説明をお願いします。

ベッカー:事案は以下の通りです。

ベルリンの銀行(以下「Y 銀行」といいます。)が、オンラインでクレジットカードの申

込みを受けつけ、自動スコアリングにより、申込者の信用力を評価し、クレジットカード

の発行可否を判断するサービスを提供していました。 Y 銀行は、申込フォームで取得した情報に加えて、外部ソースから得た追加データに依拠して信用力を評価していました。 Y 銀行があらかじめ定めたスコアリングのロジックおよび基準に基づき、特段の理由を示すことなく、ある顧客(以下「X」といいます。)の申込みを否決しました。

否決後、X は、Y 銀行に対して説明を求めました。しかし、Y 銀行は、スコアリングの一般

的・標準化された説明のみを提供し、具体的な否決の理由を説明しませんでした。つまり 、

どのようなデータの区分、どの決定的要素、どの基準が否決という結果に至ったのか、な

どの情報提供を拒絶しました。

その結果、X は、Y 銀行の判断の根拠を理解することができず、どの点が不正確である可

能性があるのか、または争いのために重要となりうる点が何かを特定できませんでした。

X は信用状態が良好であり、かつ安定した高収入があったため、Y 銀行による否決に疑問

を抱き、ベルリンのデータ保護監督機関に苦情を申し立てました。

松岡:X による申立ての結果、Y 銀行に制裁金が課せられたということですね。データ保

護監督機関の決定の内容を教えてください。

ベッカー:決定の概要は以下の通りです。

===

銀行によるクレジットカード申込の否決のように、個人に対して重大な影響を及ぼす「完全に自動化された決定」を行う場合、管理者(controller)である銀行は、その個人に対して、個別事案に即した「意味のある情報」を提供しなければならない。

この情報提供の目的は、アルゴリズム自体を開示することではない。当該情報提供の目的

は、データ主体が当該結果を理解し、GDPR22 条 3 項が定める保護(「人の関与を得る権利」、「自己の見解を表明する権利」、「決定を争う権利」)を実効的に行使できる水準

で説明することにある。

Y 銀行の画一的な説明は、この基準を満たさないので、GDPR22 条 3 項、15 条 1 項(h)、および 5 条 1 項(a)に違反するものといえ、30 万ユーロの制裁金を課す。

===

松岡:ありがとうございます。

制裁金の金額である 30 万ユーロ(約 5500 万円)については、どのような考慮がされたの

でしょうか。

ベッカー:公表されているベルリンのデータ保護監督機関のプレスリリース( https://

www.datenschutz-berlin.de/pressemitteilung/computer-sagt-nein/)によれば、データ

保護監督機関は、Y 銀行の経済的能力(売上高を含む)や違反の性質・重大性を踏まえて

制裁金を評価し、また、申立後に Y 銀行により講じられた是正措置や、データ保護監督機

関の手続きにおける Y 銀行の協力を減軽事情として考慮したとのことです。

2.ベルリン事案において Y 銀行が違反した GDPR の条文の説明

松岡:Y 銀行が違反した GDPR の条文について説明をお願いします。

ベッカー:

(1)GDPR22 条 1 項

GDPR22 条 1 項は、「(i)プロファイリングを含む自動処理のみに基づき、 (ii)『法的効果ま

たはこれに準ずる重大な影響』をデータ主体にもたらす決定の対象とならない権利」を

データ主体に認めています。これは、日本法には直接の対応規定がありません。

「自動処理のみに基づく」とは、その決定が人によって実質的にレビューされていないこ

と、または、人が影響を与えていないことを意味します。人による形式的チェックでは足りず、人が実際に結果を評価し、必要に応じて変更できることが必要です。

与信(クレジット)拒否は、その人が金融サービスへアクセスできるか否かを左右するた

め、明らかに「重大な影響」に該当します。

(2)GDPR22 条 2 項 GDPR22 条 2 項は、例外的・限定的に自動化決定を許容しています。すなわち、(a) 契約の

締結または履行に必要な場合、(b) EU 法または加盟国法により認められている場合、または (c) 本人の明示的同意に基づく場合です。

実務上、与信スコアリングのビジネスに関しては、多くの管理者( controller)は「契約

の必要性」を根拠として自動化決定の例外的許容を求めます。重要なのは、これらの例外

が透明性や公正性の義務を免除するものではない点です。例外は、厳格な条件下で自動化

を許容するにとどまります。

(3)GDPR22 条 3 項

GDPR22 条 2 項の(a)や(c)に該当する場合でも、データ主体に対して、「人間による介入を得る権利」「自分の見解を述べる権利」「決定を争う(contest)権利」を行使させるための保護措置を確保する必要があります。

ベルリン事例においては、データ保護監督機関は、 Y 銀行が個別事案に即した具体的な説

明を提供しなかったため、これらのセーフガードが機能していないと結論付けました。システムがなぜ申込みを否決したのかが分からなければ、X は意味のある形で、当該否決に

ついて争うことができません。したがって、データ保護監督機関は 22 条 3 項違反を認定し

ました。

(4)GDPR15 条 1 項(h)GDPR15 条は、アクセス権(開示請求)を定めています。データ主体は、GDPR15 条に基

づき、色々な個人データにアクセスできるところ、同条 1 項(h)は、「プロファイリン

グを含め、第 22 条第 1 項及び第 4 項に定める自動的な決定が存在すること、また、それが

存在する場合、その決定に含まれている論理、並びに、そのデータ主体への重要性及び

データ主体に生ずると想定される結果に関する意味のある情報」にアクセスすることを認

めています。

これは、アルゴリズム、ソースコード、または営業秘密の開示を要求するものではありま

せん。そうではなく、データ主体が判断理由を理解できる水準での説明が求められます。

ベルリン事案では、Y 銀行はシステムの一般的説明は提供したものの、なぜ X の申込みが

否決されたのかを説明しませんでした。そのためデータ保護監督機関は GDPR15 条 1 項(h)違反を認定しました。

(5)GDPR5 条 1 項(a)GDPR5 条は、個人データの取り扱いに関する基本原則を定めています。様々な基本原則が

定められているところ、GDPR5 条 1 項(a)は、個人データ処理の基本原則として「適法

性・公正性・透明性」を定めています。

ベルリン事案において、データ保護監督機関は、抽象的なシステムの説明だけでは透明性

の原則に違反することを明確にしました。自動化決定が本人に重大な影響を及ぼす場合、透明性の原則を遵守するためには、データ主体が自分の個別ケースでどのように判断が導

かれたのかを理解できる情報が必要です。

Y 銀行の説明は一般的すぎてこの要件を満たさないとして、データ保護監督機関は、

GDPR5 条 1 項(a)の透明性原則違反も認定しました。

3.仮に EU AI Act がベルリン事案に適用された場合、どのような点が問題となるか

松岡:ベルリン事案は 2023 年時点のものですので、EU AI Act はまだ適用されませんでした。仮に、この事案について EU AI Act が適用されるとどうなりますか?

(1)AI システム

ベッカー:AI Act の出発点は、検討対象の技術が、AI Act 3 条 1 項にいう「AI システム」に該当するかどうかです。AI システムに該当して初めて AI Act が適用されます。

AI システムとは「明示または黙示の目的のために、入力データから推論を行い、予測、推奨、または意思決定等のアウトプットを生成し、それが物理的または仮想環境に影響を与

え得る、様々な自律性の水準で作動するよう設計された機械ベースのシステム」をいいま

す。リサイタル 12 は、推論(inference)の概念がこの定義の中核であることを明確にし

ています。

したがって、学習済みモデル(例えば、機械学習モデルや統計モデル)を用いて、入力データから確率やスコアを算出し、それに基づいて承認・否決といった意思決定を導くシステムは、多くの場合、「AI システム」に該当すると思います。

これに対し、人があらかじめ定めた固定的なルール(例えば、硬直的な if-then ロジック

や静的な閾値テーブル)をそのまま適用するだけの、純粋に決定論的( deterministic)な

システムは、AI Act が定める推論を行わないため、「AI システム」の定義から外れる可能

性があります。あるスコアリングツールが AI に該当するかは、自動化されていること自体

ではなく、その技術的アーキテクチャに依存します。

松岡:なるほど。「与信審査の自動化」は、直ちに AI Act 上の「AI システム」には該当せ

ず、推論の有無がポイントになるわけですね。

ベッカー:そのとおりです。自動化だけで AI Act が直ちに適用されるわけではありません。

AI Act は、事前定義のロジックを実行するだけなのか、それとも推論を行うのかに焦点を

当てています。

(2)ハイリスク AI 該当性

松岡:それでは、仮に Y 銀行のシステムが「AI システム」に該当するとすれば、どうなり

ますか?

ベッカー:「AI システム」に該当するとすれば、次のステップは、AI Act のリスクベース

構造に基づく分類を検討する必要があります。

AI Act 6 条は、付属書 III に列挙された一定のカテゴリに該当する AI システムをハイリスクとみなすことを定めています。そのカテゴリの一つが、金融詐欺の検知のみに用いられる場合を除き、自然人の信用力を評価したり、信用スコアを設定したりするために用いられる AI システムで(付属書 III、5(b))。

ベルリン事案のシステムは、クレジットカード発行可否を判断するために信用力評価に用いられているため、AI システムに該当するのであれば、このカテゴリに該当する可能性が

極めて高いです。その場合、AI Act 6 条および付属書 III により、ハイリスク AI として扱

われる可能性が高いでしょう。

(3)ハイリスク AI のデプロイヤーの義務

松岡:ハイリスク AI に該当する場合、プロバイダーやデプロイヤーの義務が問題になると思います。ベルリン事案の Y 銀行は、少なくともデプロイヤーには該当すると思いますの

で、デプロイヤーから説明をお願いします。

ベッカー:デプロイヤーとは、自らの権限に基づき AI システムを利用する者です(AI Act3 条4号)。Y 銀行は意思決定プロセスにおいて当該システムを使用しているため、明らかにデプロイヤーに該当します。

松岡:ハイリスク AI に関するデプロイヤーの義務を教えてください。

ベッカー:ハイリスク AI のデプロイヤーの義務は、主に AI Act 26 条に定められています。

その義務を要約すると、デプロイヤーは、システムが適法・安全で、意図された目的に

従って使用されることを確保しなければなりません。

詳細な説明は省きますが、デプロイヤーの中核的義務としては、例えば、以下が含まれま

す。

・提供者の使用説明書(instructions for use)に従ってシステムを運用すること

・適切な人による監督(human oversight)を確保すること

・意図された目的に照らして関連性があり、十分に代表性のある入力データを用いること

・システム運用を監視し、重大インシデントや不具合を報告すること

・遵守を証明するために必要な場合はログを保持すること

実務上、デプロイヤーは AI Act における「AI システムの運用面のコンプライアンス層」と

して機能します。仮にプロバイダーが適切に AI システムを開発し、適切に対応していたと

しても、デプロイヤーが誤って AI システムを運用すれば、AI Act に違反することとなりま

す。

(4)ハイリスク AI のプロバイダーの義務

松岡:Y 銀行が、ハイリスク AI のプロバイダー(開発者、または、開発済みの AI を保有

し自己の名や商標でそれを市場に流通させるまたはサービスを提供する者。 AI Act 3 条 3

号)に該当するかどうかは分かりませんが、仮にプロバイダーに該当する場合、どのよう

な義務を負うか、教えてください。

ベッカー:ハイリスクAIのプロバイダーの義務は、設計および規制適合性

(conformity)について責任を負うため、デプロイヤーよりも大幅に重くなります。 AI Act は、とりわけ (1)リスク管理システム、(2)データ・ガバナンスおよびデータ品質管理、(3)技術文書、(4)自動ログ機能、(5)デプロイヤー向け透明性、(6)実効的な人による監督を可能にする設計、(7)正確性・堅牢性・サイバーセキュリティの確保、(8)開発およびライフサイクル過程を統括する品質管理システム、といった包括的なコンプライアンス枠組みの構築・維持をプロバイダーに求めています。

また、ハイリスク AI を市場に投入する前に、プロバイダーは AI Act 遵守を示す適合性評価(conformity assessment)も受けなければなりません。「整合規格」(harmonised

European standards)が採択されれば、法的要件に対する適合の推定(presumption of

conformity)を得る手段となることが想定されていますが、これが唯一の対応方法という

わけではありません。

松岡:ハイリスク AI に関する義務の適用開始は、2026 年 8 月とされているのに、正式な

「整合規格」が公表されておらず、困るという相談を受けることがあります。「整合規

格」に関する現状を教えてください。

ベッカー:2025 年 10 月 30 日、欧州標準化委員会(CEN)及び欧州電気標準化委員会

(CENELEC)が、整合規格 prEN 18286(EU AI Act に関する品質マネジメントシス

テム)のドラフトがパブリックコメントに付されました。ただし、公式の整合規格として

正式に採択・公表されるまでには、なお時間を要する可能性があります。

松岡:ハイリスク AI の開発には時間が必要ですし、ハイリスク AI の開発段階において、

「整合規格」は参照すべきものです。この状況はハイリスク AI の開発者にとって非常に厳

しいですね。

ベッカー:確かにそうです。こうした懸念が表明されていることから、欧州委員会が公表

した「デジタル・オムニバス(Digital Omnibus)」提案により、ハイリスク AI に関する

義務の適用が延期される可能性がある、という報道もあります。ただし、立法改正が正式

に採択されない限り、企業は現行の法定スケジュールを前提として計画を立てる必要があ

ります。

松岡:AI Act が適用されることを想定している AI の開発会社は、どうすればよいでしょう

か。

ベッカー:慎重なアプローチとしては、(1)当該システムが AI Act 上の AI システムに該当

するかを判断し、(2)ハイリスク AI カテゴリに該当するかを判断し、(3)該当する場合は、

AI Act が定める要件に整合する内部コンプライアンス枠組みを既に今の段階から実装する、

という 3 ステップで進めることです。

実務的には、ガバナンス体制、文書化プロセス、リスク評価手続、透明性資料を、ローン

チ後ではなく開発段階で作り込むことが必要です。整合規格は、今後確定すれば取り込む

ことができますが、整合規格の確定を待って準備を先送りすると、AI Act に違反するリス

クを高めることになります。

3. 日本法の場合

ベッカー:ベルリン事案のようなシステムを日本で導入する場合、どうなりますか。

松岡:日本には GDPR22 条のような「自動化された決定に対する権利」を定めた規定はあ

りません。日本では、個人情報保護法上の利用目的規制が適用されることとなります。利

用目的規制が適用されますので、企業は、プロファイリングなどの利用目的を公表する必

要があります(個人情報の保護に関する法律についてのガイドライン(通則編) 3-1-1、「個人情報の保護に関する法律についてのガイドライン」 に関するQ&A 2-1)。

また、GDPR がアクセス権を定めているように、日本の個人情報保護法は、開示請求を認

めています(個人情報保護法 33 条)。この規定に基づき、ベルリン事案の X のように、

与信審査の否決の理由を求めることができるかもしれません。ただし、アルゴリズムの開示は営業秘密との関係で問題があるともされている点にも留意が必要です。

ベッカー:AI Act を除けば、ベルリン事案に関する欧州と日本の法的規律は似ているよう

に思います。いずれの規律も、透明性と正当な事業上の利益の保護とのバランスを図ろうとしている点は共通です。大きな違いは、欧州法は自動化された意思決定を独立の法的カ

テゴリとして明示的に規律するのに対し、日本法は、目的特定、開示請求権などを通じて

間接的に対応している、という点にあるように思います。

松岡:そうですね。また、ベルリン事案では、制裁金が課せられましたが、日本の個人情報保護法は、まだ制裁金規定を有していないことも大きな違いです。

4.日本と欧州の AI に関する規律の違い

松岡:AI Act の義務は重すぎるように思います。また、GDPR22 条のような法的規律は、

本当に必要なのでしょうか。人間が関与した判断の方が、誤ったものとなったり、社会的

に相当でない結論となる場合もあると思うのですが。

ベッカー:そのとおりです。人によるレビューがあっても、正確または公正な結果が保証

されるわけではありません。しかし、GDPR22 条や AI Act の規定の趣旨は、自動化が本質的に悪いということではなく、自動化された意思決定は、人間の意思決定よりもはるかに

速く、かつ体系的にリスクを拡大し得るので、それに適切に対応する必要がある、という点にあります。

欧州の規制は、三つの構造的セーフガードに重点を置いています。すなわち、 (i)意味のある水準での意思決定ロジックの透明性、(ii)影響を受ける個人の手続的権利、(iii)システム運用者の組織的アカウンタビリティ(説明責任)です。

この規制の目的は、リスクを完全に排除すること(それは非現実的です)ではなく、リスクが検知可能で、争うことができ、是正可能な状態に保たれることです。

松岡:なるほど。日本は AI Act のような重い規制は定めていませんが、AI を利用してなんでもしてよいと認めているわけではありません。例えば、アルゴリズムが差別的に設計されており、社会的に相当ではない与信審査となるような場合、金融当局から指導を受ける可能性があると思います。

また、産業の発展と規制との関係も気になります。AI Act のような厳しい規制を設けると、

AI の産業が発展しないようにも思います。

日本では、AI を利用しないことにより技術革新に取り残されて中長期的に良質なサービス提供が困難になる「チャレンジしないリスク」が強調されるようになりました( AI ディスカッションペーパー(第 1.0 版)p4)。

日本は、AI Act のような厳しい規制は設けず、チャレンジしないリスクを強調することに

より、AI を利用したビジネスを発展させようとしていると思います。

ベッカー:欧州も AI イノベーションを追求していますが、異なる規制戦略を選択しました。

大まかに言えば、日本の現在のアプローチは、イノベーションを優先しつつ事後的にリスクをコントロールするものと位置付けられる一方、欧州のアプローチは、まずリスク分類を行い、事前にコンプライアンス義務を課すものです。

欧州では、特定の AI ユースケース(特に、必須サービスへのアクセス、雇用、与信、または公的意思決定に影響するもの)については、導入後に多数の人に同時に影響を与え得るため、システミックなリスクが予見可能である以上、当初から構造的セーフガードが必要だ、という前提が置かれています。

したがって、違いは、一方がイノベーションを重視し、他方が重視しないということでは

ありません。むしろ相違は、法的介入が「いつ」「どのように」行われるかにあります。

・日本は、具体的リスクが顕在化した後に規制する傾向があります。

・EU は、システミックなリスクが予見可能な場合に、事前に規制する傾向があります。

いずれのモデルも、イノベーションと保護の均衡を目指していますが、その均衡を技術のライフサイクルのどの時点で具体化するかが異なります。

質問等は、以下にご連絡ください。

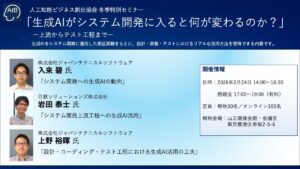

人工知能ビジネス創出協会 事務局

対談者ご紹介

渥美坂井ヤンセン弁護士法人(ドイツ、フランクフルト) マネージング・パートナー

ドイツ連邦共和国弁護士(Rechtsanwalt) フランク・ベッカー

英国及び米国の名高い法律事務所において15年以上の勤務経験を有し、主に欧州や日本におけるプライベート・エクイティ、企業再編及びクロスボーダーのM&A等の大型案件、及び、内部通報制度やGDPR等、コンプライアンスに関する事案について助言を提供している。

対応可能な言語は、ドイツ語、日本語、英語、スペイン語及びフランス語

松岡吉田法律事務所

AIB協会理事 松岡史朗(まつおか ふみあき)

渥美坂井ヤンセン弁護士法人(ドイツ、フランクフルト) マネージング・パートナー

ドイツ連邦共和国弁護士(Rechtsanwalt) フランク・ベッカー

京都大学法学部卒業。

上記の役職の他、一般社団法人日本DPO協会顧問、ステート・ストリート信託銀行株式会社社外取締役(監査等委員)も務める。

ご質問等は、以下にご連絡ください。

人工知能ビジネス創出協会 事務局